A inteligência é sua.

A soberania também.

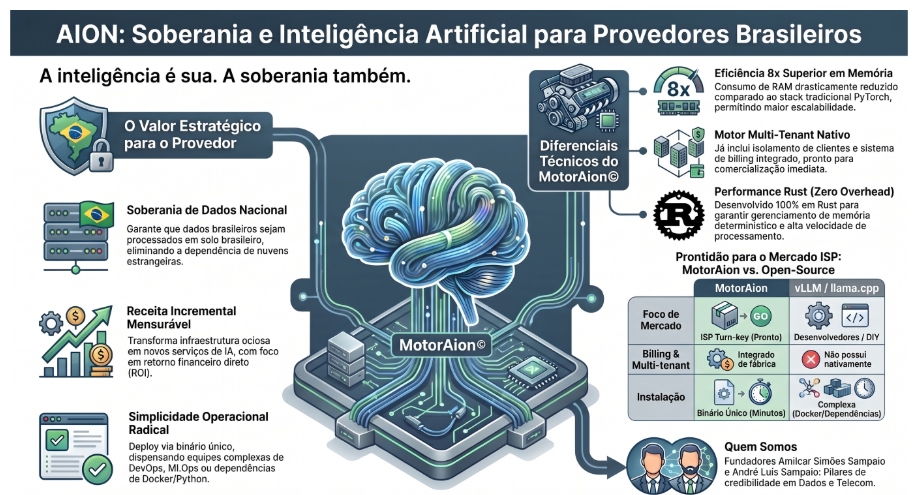

Transformamos datacenters de provedores brasileiros em plataformas de AI soberana — para que nenhum dado brasileiro precise sair do país para ser inteligente.

MotorAION: inferência LLM 100% brasileira.

Motor de inferência em Rust com deploy de binário único. Multi-tenant nativo, RAG integrado, sem CUDA, sem Docker, sem Python. Setup em minutos, não em dias.

Transforme seu datacenter em um hub de AI.

Consultoria especializada em arquitetura de AI soberana — do diagnóstico do seu parque até a operação em produção, com modelo de parceria continuada.

Do diagnóstico à operação em produção

- Avaliação de capacidade do datacenter atual

- Desenho de arquitetura de AI soberana

- Implantação assistida do MotorAION

- Treinamento da equipe técnica local

- Operação continuada como parceiro

Premiados onde a indústria de AI brasileira acontece.

Nossa equipe construiu o data lake em produção da maior empresa de infraestrutura de telecom do Brasil — gerando R$20MM/ano em ganhos, com projeção de R$100MM para 2026.

Não entregamos relatórios.

Entregamos receita nova.

Cada provedor regional, um hub de AI para sua comunidade. Cada datacenter no interior, uma nova linha de receita. Sem depender de cloud estrangeira.